Je gaat solliciteren op een nieuwe baan en hoort dat er bij de selectie gebruik wordt gemaakt van artificial intelligence (kunstmatige intelligentie of AI). Wat betekent dat? Psychologisch advies- en onderzoeksbureau NOA deed onderzoek naar het gebruik van AI bij selectie. De uitkomsten werden vergeleken met die van traditionele selectiemethoden. Welke kandidaten hebben het meest winst van de toepassing van AI? En is selectie met gebruik van AI betrouwbaar?

De inzet van algoritmes bij werving & selectie heeft een zeer snelle vlucht genomen: CV screening, chatbots, gezichtsherkenning, videointerviewing... de mogelijkheden zijn legio. Maar hoe beïnvloedt het gebruik van AI de kansen op werk voor verschillende partijen? HR technologie is niet neutraal. Hoe verbinden we de bestaande kennis uit de personeelspsychologie met de wereld van recruitment-algoritmes? Hoe kan AI een goede en eerlijke arbeidsmarkt faciliteren - of frustreren? Hoe maken we de werking van AI eerlijk en transparant? Hoe kunnen we ervoor zorgen dat computersystemen op een verantwoorde manier worden ingezet?

Psychotechniek revisited

Psychotechniek revisited

Kunnen AI en personeelspsychologie van elkaar leren? In het werving- en selectieproces is de afgelopen eeuw veel kennis ontwikkeld (meten van geschiktheid, toetsen van instrumenten op validiteit en betrouwbaarheid, terugdringen van bias). Inmiddels wordt artificiële intelligentie (AI) ingezet bij recruitment en selectie. Hoe verbinden we bij de ontwikkeling van algoritmes de kennis van ICT met de bestaande kennis over personeelsselectie?

Hoe AI een hele arbeidersklasse onzichtbaar maakte

Hoe AI een hele arbeidersklasse onzichtbaar maakte

De 'dirty little secret' van AI vraagt om een nieuw gesprek over de toekomst van werk, en hoe mens en machine daarin samenwerken. Met de installatie Guest Worker maken we de verborgen arbeidersklasse zichtbaar. Het maakt ook duidelijk dat hier van een evenwichtige samenwerking tussen mens en machine geen sprake is. Voor de menselijke werkers ontbreken er mogelijkheden om hun menselijke meerwaarde tot uitdrukking te brengen, waardoor inclusiviteit en diversiteit loze begrippen worden.

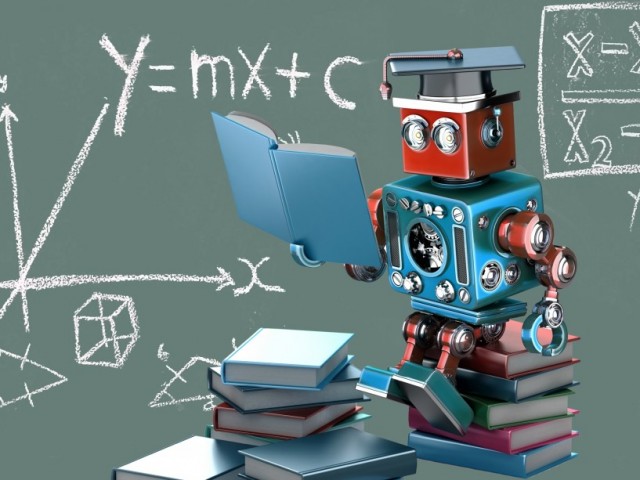

Is selectie met inzet van AI eerlijker en accurater?

Pas op de plaats voor grote beloften van AI in recruitment

Pas op de plaats voor grote beloften van AI in recruitment

Op welke kenmerken verschilt de lijst van geschikte kandidaten, wanneer machine learning modellen worden gebruikt in plaats van meer traditionele technieken? Komen er meer inclusieve, diverse keuzes of juist meer exclusieve keuzes in geschikte kandidaten in praktijk tot stand? Of maakt het geen verschil? Jacqueline van Breemen (NOA) deed onderzoek naar de consequenties van selectie met behulp van AI op de diversiteit van de geselecteerden. Ze won hiermee tevens de Eindprijs van de NSvP AI x Recruitment Challenge.

Ervaar de impact van technologie op jouw eigen sollicitatie

Ervaar de impact van technologie op jouw eigen sollicitatie

Om de dilemma’s rondom de digitalisering van de arbeidsmarkt inzichtelijk en invoelbaar te maken, zette de NSvP samen met SETUP een Makers-Challenge uit. Vier creatieve multidisciplinaire ontwerpteams zijn gevraagd een werk te maken om dit thema goed, urgent en uitdagend te verbeelden. Hoe is het om door een computerprogramma te worden afgewezen op je droombaan? En hoe ervaar jij het als jouw videosollicitatie wordt beoordeeld door een robot? Zou jij nog aangenomen worden voor je eigen baan als je met de Selection Automat moest solliciteren?

AI en recruitment als kat-en-muisspel

AI en recruitment als kat-en-muisspel

Wat als AI de recruitmentrollen omdraait? Steeds vaker gebruiken organisaties HR-technologie en analytics ten behoeve van beter matchende en presterende medewerkers. Maar wat als individuele werkenden op hun beurt dit ook gaat inzetten om werkgevers en hun HR-beleid beter te kunnen inschatten?

Werken aan scenario's voor AI en de arbeidsmarkt

Werken aan scenario's voor AI en de arbeidsmarkt

Een groep makers uit allerlei verschillende hoeken (van programmeur tot schrijver van historische romans, en van kostuumontwerper tot cultureel antropoloog) ontwikkelt installaties, performances en andere werken om tastbaar te maken wat de maatschappelijke gevolgen van AI in de HR-sector (kunnen) zijn. Want erover lezen is één ding, maar de gevolgen worden pas echt invoelbaar als je zelf een door een algoritme aangestuurd sollicitatiegesprek ondergaat. SET-UP stelt ze voor.

Algoritmes leiden niet automatisch tot eerlijkere selectie

Algoritmes leiden niet automatisch tot eerlijkere selectie

Voorstanders van het gebruik van artificiële intelligentie voor personeelsvraagstukken stellen dat het kan leiden tot meer inclusieve werkomgevingen. Tegelijkertijd is er een groeiend besef dat algoritmes zijn gebaseerd op menselijke input. Hoe kunnen we ervoor zorgen dat AI op een verantwoorde manier wordt ingezet?

Algoritmisering en de black box - tijd voor verklaarbare AI?

Algoritmisering en de black box - tijd voor verklaarbare AI?

Black boxes bij AI treden op wanneer machine learning systemen beslissingen maken die door de gebruiker niet duidelijk of vanzelfsprekend zijn. Dit kan onbedoeld leiden tot discriminatie of een gebrek aan vertrouwen. Transparantie, verklaarbaarheid, verantwoordelijkheid zijn belangrijke kenmerken voor een begrijpelijk en uitlegbaar AI-systeem. Waarom gebruikt niet iedereen Explainable AI? En wat vinden we er eigenlijk van als een machine een onverklaarbare beslissing neemt?

Het algoritme is kapot

Het algoritme is kapot

"Onze hersenen zijn in de basis ook algoritmes. Vanuit een reeks instructies, die we vaak onbewust geven, komen we tot een conclusie, bijvoorbeeld wie we uitnodigen voor een sollicitatiegesprek of wie na zo'n gesprek de baan krijgt." Bas van de Haterd legt in zijn column uit waarom algoritmes juist kunnen zorgen voor een eerlijke kans op de arbeidsmarkt voor iedereen.

Wie hebben het meest baat bij gebruik van AI in selectie?

Wie hebben het meest baat bij gebruik van AI in selectie?

Jacqueline van Breemen (onderzoeker en data analist bij NOA) deed onderzoek naar het gebruik van AI bij selectie. Ze vergeleek de uitkomsten met die van traditionele selectiemethoden. Welke kandidaten hebben het meest winst van de toepassing van AI? En is selectie met gebruik van AI betrouwbaar? Haar belangrijkste uitkomst: selectie met AI versterkt sommige bestaande vooroordelen.

De psychologie van robotisering van werk: 4 technologie-fantasieën

De psychologie van robotisering van werk: 4 technologie-fantasieën

Matthijs Bal schrijft over de psychologische aspecten van technologie; meer specifiek over de vier fundamentele fantasieën die bestaan ten aanzien van de rol van technologie in werk en maatschappij. Technologie heeft een onmiskenbare rol gespeeld in de globalisering, en speelt ook een belangrijke rol bij andere grote uitdagingen van onze tijd: klimaatverandering en maatschappelijke ongelijkheid. Maar wat heeft de organisatiepsycholoog nu te zeggen over technologie en de rol van technologie in werk en maatschappij?

AI en recruitment: twee handen op een buik of liefde van één kant?

AI en recruitment: twee handen op een buik of liefde van één kant?

AI heeft binnen werving & selectie veel potentie. Het toepassen van algoritmes op meer ‘softe’ sociale variabelen (zoals persoonlijke eigenschappen en vaardigheden) - in plaats van meetbare, feitelijke variabelen (zoals aantal jaar werkervaring) - als voorspellers van succes en gedrag is echter nog een groot grijs gebied. Daarom is wetenschappelijk onderzoek in dit veld zo belangrijk. Zodat de werkzoekenden van de toekomst hun voordeel kunnen doen met het onderzoek van vandaag. Een gesprek met onderzoekers Janneke Oostrom (Vrije Universiteit Amsterdam), Jaap Jan van Assen (eelloo) en Jacqueline van Breemen (NOA).

Waarom AI niet neutraal is: bias #1

Waarom AI niet neutraal is: bias #1

Stel, een organisatie wil uit een grote groep mensen een selectie maken van 'goede' werknemers. Hoe definieer je ‘goed’ in meetbare eigenschappen? Is een goede werknemer iemand die de meeste producten verkoopt? Iemand die nooit te laat komt? Het lijken redelijke overwegingen in het voorspellen van ‘goede’ werknemers, maar uitsluiting van groepen mensen is hierbij reëel. Deel 1 uit een serie: Hoe een doelvariabele kan leiden tot (onbedoelde) discriminatie.

Waarom AI niet neutraal is: bias #2

Waarom AI niet neutraal is: bias #2

Wat een algoritme leert, hangt af van de ‘trainingsdata’ waaraan het is blootgesteld. Deze gegevens trainen het algoritme om zich op een bepaalde manier te gedragen. De kwaliteit en waarde (en neutraliteit) van de ingevoerde data is hierbij dus essentieel. Dit valt onder te verdelen in twee categorieën: ‘labelling examples’ en ‘data collection’. Deel 2 in de (5-delige) serie Waarom AI niet neutraal is.

Waarom AI niet neutraal is: bias #3

Waarom AI niet neutraal is: bias #3

Als je algoritmes wil gebruiken om iets automatisch te voorspellen, moet je de wereld vereenvoudigen om het in programmeertaal te kunnen vastleggen. Bijvoorbeeld: wil je een slimme kandidaat - neem iemand met een universitair diploma. Organisaties maken dus keuzes over welke indicatoren ze opnemen in hun algoritmische analyses. Dit keuzeproces - ‘feature selection’ - werkt biases in de hand. Deel 3 uit een serie van vijf.

Waarom AI niet neutraal is: bias #4 proxies

Waarom AI niet neutraal is: bias #4 proxies

Proxies zijn cijfers die correlaties aanduiden tussen bepaalde concepten, waardoor ze voor een algoritme dienen als een soort voorspellers. Blond haar is bijvoorbeeld een proxy voor een blank huidtype. Aan de hand van zulke correlaties worden mensen ingedeeld in groepen. Er ontstaan patronen waaruit blijkt dat bepaalde groepen gemiddeld slechtere prestaties, vaardigheden of capaciteiten vertonen, met als gevolg een systematische uitsluiting van die groepen. Wat kunnen we eraan doen?

Waarom AI niet neutraal is: bias #5 masking

Waarom AI niet neutraal is: bias #5 masking

Waar we in eerdere artikelen spraken over hoe het gebruik van data mining en algoritmes onbedoeld kan leiden tot discriminatie bij de werving en selectie van personeel, draait dit laatste mechanisme de rollen een beetje om. Algoritmes bieden namelijk handvatten om juist bewust te discrimineren. We bespreken het laatste mechanisme: masking.

Eerlijkheid binnen AI: het sollicitant-perspectief

Eerlijkheid binnen AI: het sollicitant-perspectief

HR-medewerkers die CV's en motivatiebrieven beoordelen hebben plaatsgemaakt voor e-recruitment of ATS (Applicant Tracking System). Met algoritmes worden CV’s en brieven gescand op bepaalde kenmerken, op basis waarvan de sollicitant wordt afgewezen of op gesprek mag. Wordt deze manier van afwijzen als eerlijk ervaren? De ervaring van de sollicitanten is bepalend voor maatschappelijke acceptatie van de inzet van AI bij recruitment.

Winnaars AI x Recruitment Challenge bekend

Winnaars AI x Recruitment Challenge bekend

Hoe krijgen we meer inzicht in de werkelijke werking van AI en algoritmisering voor het verbeteren van recruitmentbeslissingen? Deze open vraag vormde de aanleiding voor de NSvP AI x Recruitment Challenge in 2019. Welke ideeën hebben we mogen ontvangen? En wie zijn de drie winnende partijen die dit jaar de uitdaging van de Challenge aangaan?

OmkeerEvent 2019: een terugblik op AI in Recruitment

OmkeerEvent 2019: een terugblik op AI in Recruitment

De aanwezigen hebben hun kennis over algoritmische toepassingen de hele middag flink bijgespijkerd. Men heeft een inkijkje gekregen van de mogelijkheden, welke gevaren er op de loer liggen, en welke kansen AI kan bieden. Bovendien heeft men op ludieke wijze ervaren hoe het is om door algoritmes beoordeeld te worden. Maar heb je hier als sollicitant nou eigenlijk nog invloed op? Kun je een algoritme bijvoorbeeld voor de gek houden?

18 juni ’19: OmkeerEvent over AI in Recruitment

18 juni ’19: OmkeerEvent over AI in Recruitment

Hoe kan AI een goede en eerlijke arbeidsmarkt faciliteren of juist frustreren? Met het OmkeerEvent – AI in Recruitment – op 18 juni 2019 willen we partijen laten kennismaken met HR-technologie aangedreven door AI. Samen willen we scherper krijgen wat de tech-beloften de arbeidsmarkt van morgen écht te bieden hebben. Hoe beïnvloedt het de kansen op werk voor verschillende partijen – positief, maar mogelijk ook negatief? Welke vragen moeten we ons blijven stellen?