De drie winnaars van de David van Lennep Scriptieprijs 2024

Onderzoek naar de voordelen van ADHD op de werkvloer, samenwerking tussen mens en algoritme bij personeelsselectie en vrouwelijk leiderschap in hybride werkomgeving zijn de onderwerpen van de winnende scripties bij de David van Lennep Scriptieprijs 2024. Op 7 februari werden de drie winnaars bekend gemaakt tijdens het symposium 'Werken tot Nut van het Algemeen' in Utrecht. Franziska Linn (Vrije Universiteit Amsterdam), Shagun Thakur (Universiteit Maastricht) en Georgia de Lima Zanella (Universiteit van Amsterdam) ontvingen respectievelijk de 1e, 2e en 3e prijs en de daaraan verbonden geldbedragen van € 2.000, € 1.500 en € 1.000.

Colorwashing of diversiteitskampioen?

Het bewustzijn over het belang van culturele diversiteit op de werkvloer groeit gestaag. Onderzoek wijst uit dat een succesvolle integratie van diverse culturele groepen niet alleen bijdraagt aan een eerlijke en inclusieve samenleving, maar ook voordelen biedt voor de productiviteit van teams en organisaties. Effectief communiceren over dit thema blijft echter een uitdaging, vol met gevoeligheden en potentiële valkuilen. In de maatschappij bestaan verschillende meningen over hoe succesvol diversiteitsbeleid eruit hoort te zien. Daarbovenop heerst veel scepsis over de authenticiteit van diversiteitscommunicatie. Organisaties worden al snel beticht van 'colorwashing': positieve communicatie over culturele diversiteit zonder een link met daadwerkelijk diversiteitsbeleid. In hoeverre is deze scepsis terecht?

Beeldvorming van mensen met een Afrikaanse haarstijl

“Als je haar maar goed zit!” is een gevleugelde uitspraak. Maar wat is goed en wie bepaalt dat? Janice Odijk deed onderzoek naar natural hair-dilemma: de invloed van een natuurlijke Afrikaanse haarstijl bij sollicitaties. “Je wilt je authentieke zelf zijn en tegelijkertijd een professionele indruk achterlaten, maar het één lijkt het ander uit te sluiten”, aldus Janice. Met het onderzoek wil zij de bewustwording rond dit thema vergroten en laten zien dat onbewuste bias een rol speelt bij concepten als geschiktheid en professionaliteit.

Scriptieprijzen voor maatschappelijk relevante onderzoeken

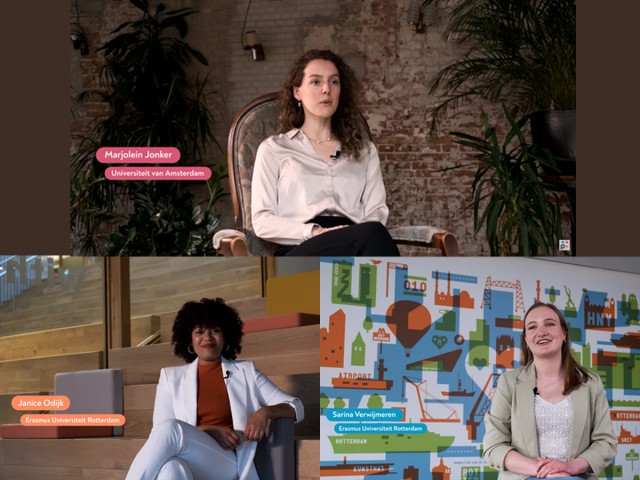

Marjolein Jonker (Universiteit van Amsterdam) won de David van Lennep Scriptieprijs met haar onderzoek naar workplace telepressure, emotionele uitputting en werk-familieschuld. De 2e en 3e prijs waren voor de Erasmus Universiteit Rotterdam: respectievelijk Janice Odijk (voor haar masterthese over Natural Hair Bias bij werving en selectie) en Sarina Verwijmeren (voor haar onderzoek naar Playful Work Design). De David van Lennep Scriptieprijs werd eind mei 2021 uitgereikt via de virtuele wereld van GoMeet.

Pas op de plaats voor grote beloften van AI in recruitment

Op welke kenmerken verschilt de lijst van geschikte kandidaten, wanneer machine learning modellen worden gebruikt in plaats van meer traditionele technieken? Komen er meer inclusieve, diverse keuzes of juist meer exclusieve keuzes in geschikte kandidaten in de praktijk tot stand? Of maakt het geen verschil? Jacqueline van Breemen (NOA) onderzocht de consequenties van selectie met AI op de diversiteit van de geselecteerden. Ze won hiermee tevens de Eindprijs van de NSvP AI x Recruitment Challenge.

Hoe groot is de bias van werving & selectie via AI?

Jacqueline van Breemen en collega’s van NOA (psychologisch advies- en onderzoeksbureau dat nauw samenwerkt met de sectie sociale en organisatiepsychologie van de Vrije Universiteit Amsterdam) laten zich uitdagen door de vraag hoe we de eerlijkheid moeten wegen van selectiebeslissingen door drie verschillende selectiemethodes. Hoe anders is de lijst van geschikte kandidaten, wanneer er machine learning modellen worden gebruikt in plaats van meer traditionele technieken? Verschilt deze lijst van kandidaten erg van elkaar? Zo ja, op welke (persoons)kenmerken precies?

Dag van de Inclusieve Arbeidsmarkt: 4 november

De NSvP, Goldschmeding Foundation(externe link) en Instituut Gak(externe link) organiseren op maandag 4 november 2019 de Dag van de Inclusieve Arbeidsmarkt. Tijdens dit symposium maken we de stand van zaken op rond de inclusieve arbeidsmarkt. Daarbij zoeken we met maatschappelijke organisaties, werkgevers, beleidsmakers en onderzoekers een concreet antwoord op de vraag welke praktische stappen er moeten worden ondernomen om de Nederlandse arbeidsmarkt inclusiever te maken.

Werken aan scenario's voor AI en de arbeidsmarkt

Algoritmes die sollicitatiebrieven beoordelen. Voice-assistants die het sollicitatiegesprek overnemen. Het voorspellen van de perfecte kandidaat voor een vacature. De mogelijkheden van AI voor werving en selectie van werknemers lijken eindeloos. Hoe ziet de toekomst van deze ontwikkeling eruit? En hoe faciliteert – of frustreert – AI de diversiteit op de arbeidsmarkt?

Waarom AI niet neutraal is: bias #5 masking

Waar we in eerdere artikelen spraken over hoe het gebruik van data mining en algoritmes onbedoeld kan leiden tot discriminatie bij de werving en selectie van personeel, draait dit laatste mechanisme de rollen een beetje om. Algoritmes bieden namelijk handvatten om juist bewust te discrimineren. We bespreken het laatste mechanisme genoemd door onderzoekers Barocas en Selbst: masking.

Het algoritme is kapot

Een algoritme is een eindige reeks instructies die vanuit een gegeven begintoestand naar een beoogd doel leiden.

Onze hersenen zijn in de basis ook algoritmes. Vanuit een reeks instructies, die we vaak onbewust geven, komen we tot een conclusie, bijvoorbeeld wie we uitnodigen voor een sollicitatiegesprek of wie na zo'n gesprek de baan krijgt.

- 1

- 2

- 3

- 4

- volgende ›

- laatste »